La tech s’unit pour combattre l'hypertrucages dans les élections

Microsoft, Adobe, Amazon, Google, Meta, OpenAI, TikTok et X ont dévoilé un accord visant à empêcher les contenus d'IA trompeurs d'interférer avec les élections de cette année.

Vendredi dernier, dans une démarche sans précédent lors de la Conférence sur la sécurité de Munich, 20 grandes entreprises technologiques ( dont Adobe, Amazon, Google, Meta, OpenAI, TikTok et X ) ont annoncé un accord révolutionnaire visant à lutter contre le fléau de la technologie des hypertrucages (deepfakes) dans le domaine de la politique électorale. Cette initiative collaborative, nommée avec pertinence Accord technologique pour combattre l’utilisation trompeuse de l’IA dans les élections de 2024, marque un tournant crucial où la communauté technologique mondiale reconnaît la nécessité urgente de protéger les processus démocratiques contre la menace insidieuse posée par les hypertrucages générés par l’IA.

Au cœur de cette initiative réside la reconnaissance de la double nature de l’avancement technologique. Alors que l’IA promet des avancées remarquables, elle permet également à des acteurs malveillants de manipuler l’opinion publique en fabriquant des contenus audio, vidéo et images convaincants – communément appelés hypertrucages (ou deepfakes en anglais). La réalité crue est que ces pratiques trompeuses sapent les fondements mêmes de la démocratie, mettant en péril l’intégrité des processus électoraux dans le monde entier.

Les objectifs de l’accord sont clairs et résolus : combattre la diffusion de contenus fabriqués qui déforment l’apparence, la voix ou les actions des personnalités politiques et d’autres acteurs cruciaux pour le cadre démocratique. Notamment, cette entreprise transcende les lignes partisanes, se concentrant plutôt sur la préservation du droit fondamental des citoyens à prendre des décisions éclairées, libres de l’influence de la manipulation pilotée par l’IA.

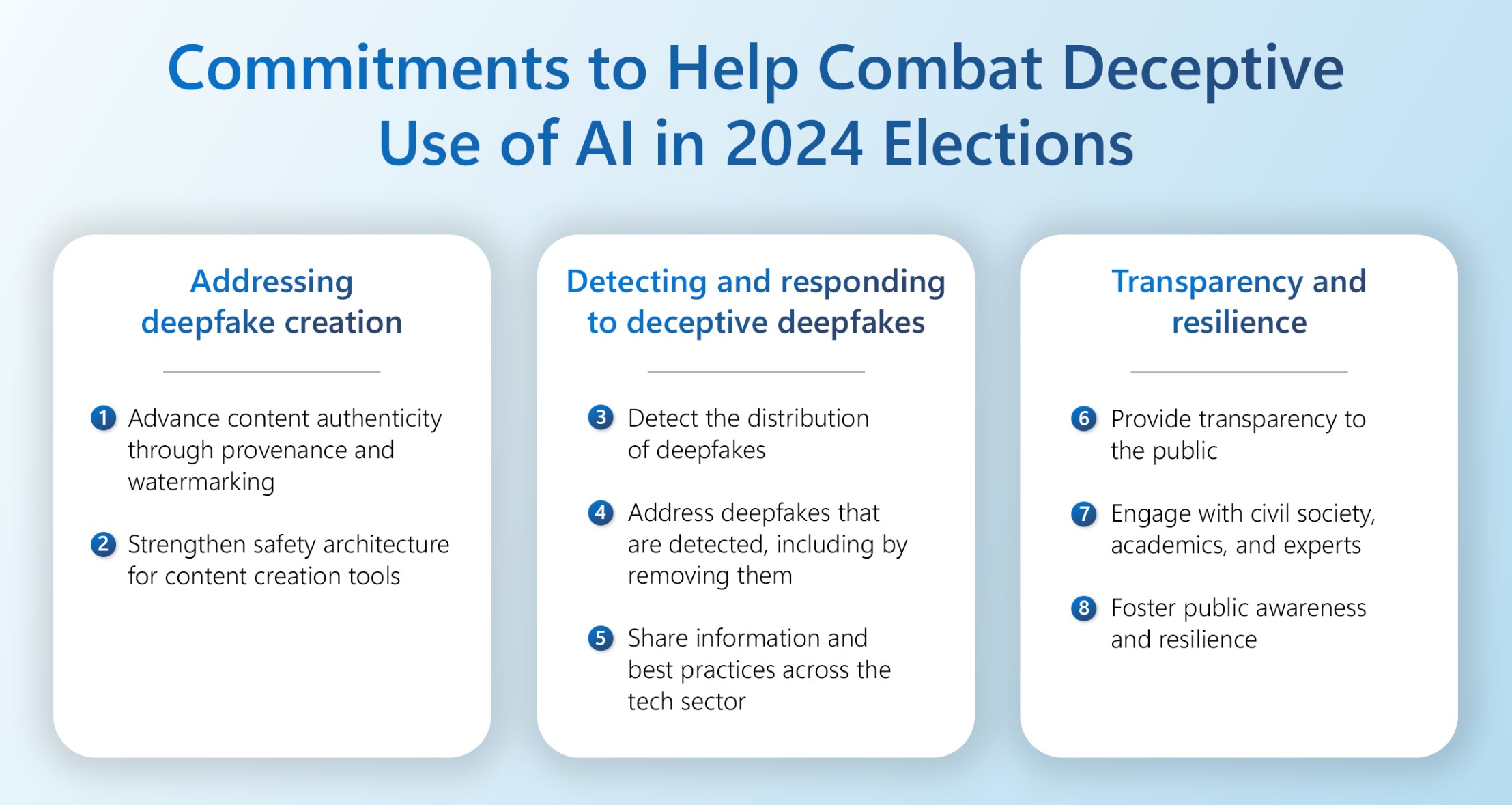

Dans une approche globale, l’accord énonce huit engagements clés visant à atténuer la menace des deepfakes. De l’amélioration de l’architecture de sécurité des services d’IA à la promotion de la provenance des contenus grâce au tatouage numérique et aux métadonnées, l’industrie se rassemble pour renforcer les défenses contre les pratiques trompeuses.

De plus, l’accord souligne l’impératif d’une action collective pour détecter et répondre aux menaces des deepfakes. En tirant parti des capacités technologiques avancées et en favorisant la collaboration entre les acteurs de l’industrie, le secteur technologique est prêt à affronter de front les tactiques évolutives des acteurs malveillants.

De manière cruciale, la transparence et la sensibilisation du public émergent comme des pivots dans la construction de la résilience sociale contre les deepfakes. L’engagement en faveur de la divulgation publique et de l’engagement avec la société civile souligne une responsabilité partagée de protéger l’intégrité électorale et de favoriser la confiance du public.

Cependant, bien que ce nouvel accord marque une étape importante, il ne représente que le début d’une bataille prolongée contre la prolifération des hypertrucages. Reconnaissant les défis redoutables à venir, les parties prenantes doivent rester vigilantes et adaptables pour lutter contre les menaces émergentes.

De plus, la responsabilité s’étend au-delà du secteur technologique, nécessitant des efforts concertés des dirigeants élus, des institutions gouvernementales et des partenariats multipartites. Le respect de l’État de droit et l’adoption de cadres législatifs robustes sont primordiaux pour freiner l’exploitation néfaste de la technologie de l’IA à des fins de manipulation électorale.

** Ce texte est également disponible sur MonCarnet.com **

...